机器人技术和人工智能(AI)的最新进展可以通过庞大数据集的快速分析和寻常任务的自动化、欺诈检测以及物流的改善来优化工作场所。

机器人技术和AI技术还可以通过外包危险工作使工作场所更加安全。随着这些技术的发展,人类的生活有望变得更有效也更有意义,因为我们将有时间专注于更重要的任务。

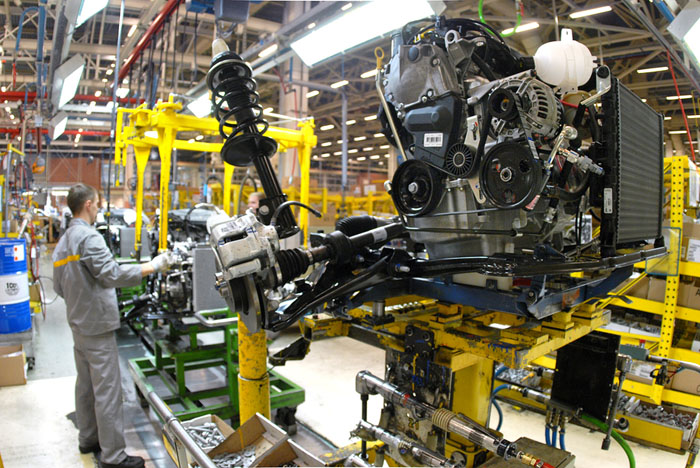

工厂装配线上新制造的发动机

由于这个领域的发展日新月异,技术领导者和学者们开始着重强调进行彻底的道德和风险评估。虽然每种新技术都伴随着风险因素,但是人类社会中的智能算法和机器人技术带来的关注远不止数据收集和隐私。实际上,它们带来的是在为时已晚之前,我们的社会需要解决的道德问题。

如果失业了,那么可能带来的不平等将走向何方?

随着更多工作实现自动化,人们将会承担更为复杂的角色。这在我们从密集型体力劳动工作转向更多认知角色时已有诸多比较。

但是,这并非如此简单!

例如,特斯拉首席执行官埃隆・马斯克(Elon Musk)承诺在不久的将来将提供自动驾驶卡车。如果自动驾驶卡车在全国范围内被广泛采用,那么社会体系就需要适当地让卡车司机无缝过渡到更有意义的角色。

目前,多数家庭通过交换时间来维持自己的可持续收入,因此这种转变可能会创造一种后工作社会。虽然可以希望这些个人能够找到更有意义的工作,但是这尚无明显迹象可循。

确实,技术可以让我们腾出时间从事更有意义的工作、与家人共度时光、照顾亲人,但是我们仍然无法确定被这项技术取代的工人是否具备必要的技能,来找到替代的收入来源。

我们目前的经济是基于对贡献模式的补偿(许多工人按小时支付)。因此,如果我们不开始重新构想和重组我们的经济以在不久的将来维持后工作社会,那么AI技术和机器人技术将有可能迅速加剧不平等的产生。

忽视这些影响会产生极其严重的后果。当人们试图在这个新世界中生存时,不平等可能迅速滋生犯罪、暴力和一般混乱。

AI偏见和错误的后果是什么?

当AI积极地从算法中学习时,就有可能会产生真实的危险后果。例如,在历史事件中,由Hanson Robotics开发的人形机器人Sophia被授予沙特阿拉伯公民身份。

然而,也是这个机器人在去年的西南偏南(SXSW)技术展期间在演示时遇到了技术故障。当人们开玩笑地问她是否会摧毁人类时,她竟回答:“好的,我将摧毁人类”,这令人惊愕不已。

此外,根据一项分析2001年到2010年编辑维基百科文章的机器人之间的交互的研究,虽然机器人旨在支持百科全书,但是机器人经常会撤销彼此的编辑且在数年内争论不休。

与平台上的人工交互相比,机器人的交互时间会更长久且会翻来覆去。与人类一样,机器人在不同文化环境中的表现也不尽相同,甚至最基本的机器人也能够进行复杂的交互。

研究影响机器人间交互的因素以及为新的创新开发适当的网络安全至关重要。

除了潜在的故障和攻击之外,系统还可能犯其它错误。不管AI根据其输入如何学习和检测正确的模式,训练阶段绝对无法涵盖系统在现实世界中可能必须处理的每个可能的案例。

无论多么聪明,这些系统仍然可能以人类不会经受的方式被愚弄。因此,如果在劳动力队伍中应用人工智能系统,那么也应当建立适当的机制来确保不会产生偏见,也不会让人类为了自己的目的而压制和利用它。

如果机器人和AI系统遭到破坏怎么办?

当勒索软件攻击成为常态时,预计很有可能发生对机器人和AI系统的攻击。如果我们继续用机器人和自主武器取代士兵,那么这些机器人和自主武器就有可能被犯罪分子和流氓政府控制。这使得网络安全对于机器人和AI系统而言都至关重要。即使这项技术不是为战争而开发的,工厂机器人和自动驾驶汽车也有可能被破坏并被用作对付我们的武器。

因此,在社会迅速应用并融入这项技术之前,我们必须首先找到构建不会被破坏的系统的方法。但是我们将处理就数量级而言比我们更强大、更快的系统。实现坚不可摧的网络安全近乎是不可能的。

机器人技术和AI技术的发展已经有目共睹。政府、企业、学术界和公众将通过积极寻找有道德的、稳步前行的方法来得到最佳服务。这意味着要为潜在的后工作社会开发新的收入模型、开发替代技能的资源、对机器人交互的深入理解、制定有效应对系统内故障的协议、以及制定安全性更优异的稳健计划。